IA, derechos de autor y la campaña del Ministerio de la Juventud e Infancia: ¿qué podría salir mal?

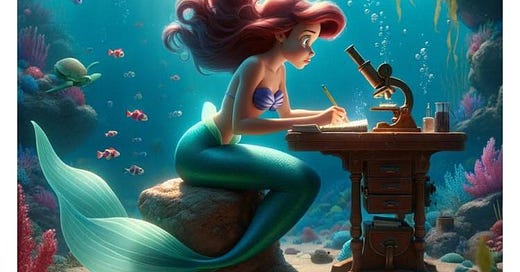

El 11 de Febrero se celebró el Día Internacional de la Mujer y la Niña en la Ciencia y al recién estrenado Ministerio de la Juventud e Infancia del Gobierno de España no se le ocurrió mejor forma de promoverlo que con un cartel generado por IA donde se utilizaban personajes femeninos de Disney (como La Sirenita o Bella) ejerciendo un rol de “mujer científica” (biológica marina, doctora, etc.). La campaña provocó tal polémica en las redes sociales, especialmente en X (anteriormente Twitter) que el Ministerio se vio obligado a retirar los carteles.

A quienes investigamos y enseñamos IA Generativa, incluyendo su marco ético y regulatorio nacional y transnacional, no deja de sorprendernos la forma en que los medios de comunicación abordaron esta polémica ni las razones alegadas no sólo por los usuarios indignados de X sino por los “sesudos tertulianos”, de esos que inundan las televisiones en abierto, que hablan a gritos y que parecen saberlo todo de todo. En muchas de esas tertulias entrañables se argumentó que el Ministerio no puede utilizar personajes de Disney sin su consentimiento y sin pagar derechos de propiedad intelectual (cosa que es cierta, aunque tampoco sabemos si el Ministerio ha pagado o dejado de pagar a Disney por el uso de sus personajes); como también se argumentó lo opuesto: que la utilización de material con derechos de autor por parte de un agente multimodal de AI Generativa para producir una imagen, no está sujeto a las actuales leyes de copyright, y por tanto, no es plagio ni infringe los derechos de autor, porque la AI no es un autor humano; argumento, este último, fácil de refutar para quien tiene un mínimo conocimiento de la Ley de IA de la UE (EU IA Act como se la conoce en el ámbito internacional) y de las obligaciones establecidas en dicha ley con respecto a legislaciones vigentes como la protección de datos (GDPR) o el copyright.

Lo que llama poderosamente la atención en esta polémica es, el desconocimiento general de una pieza clave de legislación que va a tener un impacto futuro en la sociedad y economía de los Estados miembros, como es la Ley de IA ( cuyo primer borrador la Comisión Europea presentó en el 21 de April de 2021) y, segundo, que numerosos ilustradores y diseñadores gráficos consideren las aplicaciones IA Generativa como intrusismo profesional en lugar de como una nueva herramienta para ayudarles en su trabajo. No olvidemos que, quien prefiere utilizar un agente AI multimodal para hacer un cartel y ahorrarse contratar a un ilustrador, es el ser humano, no la AI. La precariedad y el ahorro de costes la crean el capitalismo de corte anglosajón que también parecen adoptar los ministerios del “Gobierno más progresista de la historia de España”.

Sin olvidar que ninguna tecnología, ni siquiera la IA, puede entenderse fuera del marco económico, social y cultural en el que surge, en los siguientes párrafos vamos a centrarnos en clarificar las cuestiones sobre derechos de autor (o copyright), autoría intelectual y plagio que suscita la IA.

La Ley de IA de la UE describe en su Artículo 3 del Título I (Disposiciones) a todo sistema de IA como “Un sistema basado en máquinas diseñado para funcionar con diversos niveles de autonomía y que puede mostrar capacidad de adaptación tras su despliegue y que, para objetivos explícitos o implícitos, infiere, a partir de la entrada que recibe, cómo generar salidas tales como predicciones, contenidos, recomendaciones o decisiones que pueden influir en entornos físicos o virtuales;”. La ley establece cuatro niveles de riesgo para los sistemas AI, de los cuales la IA Generativa (también llamada GenAI) pertenece a los sistemas de alto riesgo. La IA Generativa es el nombre bajo el que se engloban Large Language Models (LLM) tan populares como GPT4 o Ultra 2.0, cuyos agentes AI multimodales son capaces de generar imágenes como los de la malograda campaña del Ministerio de Juventud.

Por tratarse de sistemas de alto riesgo, las aplicaciones comerciales de GenAI, tales como ChatGPT, deben cumplir los siguientes requisitos:

· revelar que el contenido ha sido generado por IA,

· diseñar el modelo para evitar que genere contenidos ilegales o plagios digitales de obras con derechos de autor,

· publicar resúmenes de los datos protegidos por derechos de autor utilizados para el entrenamiento de la AI.

¿Cómo aborda la Ley de IA las obligaciones de derechos de autor para los sistemas de IA?... El artículo 52 del Título VIII de la Ley establece las obligaciones para los proveedores de modelos de IA de propósito general, entre las que también se encuentra “establecer una política de respeto de la legislación de la Unión en materia de derechos de autor, en particular para identificar y respetar, incluso mediante las tecnologías más avanzadas, las reservas de derechos expresadas de conformidad con el artículo 4, apartado 3, de la Directiva (UE) 2019/790;” A lo que se añade que los sistemas de IA deberán “ elaborar y poner a disposición del público un resumen suficientemente detallado sobre el contenido utilizado para el entrenamiento del modelo de IA de propósito general”.

Los recitals, o considerandos adicionales de ley, que, en su mayor parte han sido actualizados en Febrero de 2024, dejan claro que los proveedores de sistemas de IA, aún siendo de licencia libre y código abierto, debe respetar la legislación vigente en protección de datos al igual que si se tratara de cualquier otro tipo de tecnología o software:

· “Cualquier uso de contenido protegido por derechos de autor requiere la autorización del titular de los derechos en cuestión, a menos que se apliquen las excepciones y limitaciones pertinentes de los derechos de autor [recogidos en la Directiva (UE) 2019/790]” (Considerando 60i(1)),

· “Cualquier proveedor que comercialice un modelo de IA de propósito general en el mercado de la UE debe cumplir con esta obligación [respetar la legislación en materia de derechos de autor establecida en la directiva Directiva (UE) 2019/790], independientemente de la jurisdicción en la que tengan lugar los actos relevantes para los derechos de autor que sustentan la formación de estos modelos de IA de propósito general.

· “la excepción prevista para los modelos de IA de propósito general [ de licencia libre y de código abierto] y del cumplimiento de los requisitos relacionados con la transparencia no debe afectar a la obligación de elaborar un resumen sobre el contenido utilizado para el entrenamiento del modelo ni a la obligación de establecer una política de respeto de la legislación de la Unión en materia de derechos de autor,” (Considerando 60f).

· “Con el fin de aumentar la transparencia sobre los datos que se utilizan en el preentrenamiento y el entrenamiento de los modelos de IA de propósito general, incluidos los textos y datos protegidos por la legislación sobre derechos de autor, es adecuado que los proveedores de dichos modelos elaboren y pongan a disposición del público un resumen suficientemente detallado del contenido utilizado para el entrenamiento del modelo de propósito general” (Considerando 60K)

Para garantizar el cumplimiento de estas obligaciones, los proveedores deberán cooperar con la Comisión Europea y regirse por código de buenas prácticas, así como rellenar las plantillas facilitadas por una futura Oficina de la IA para conocer con exactitud los contenidos que se han utilizado para el entrenamiento, y si se han utilizado contenidos que tienen derechos de autor. Esto es como pedirle las gallinas al zorro que firme una declaración de buenas intenciones antes de entrar en el gallinero y es por eso que la Ley de IA cuenta con voces detractoras y es de esperar que se realicen modificaciones posteriores al actual borrador de Febrero de 2024. Cada Estado comunitario deberá trasladar estas disposiciones una legislación nacional que garantice las herramientas de IA no plagien obras con derechos de autor. Curiosamente, el actual borrador de la Ley de IA es particularmente ambiguo en cuándo la autoría intelectual de un obra multimedia generada por la AI puede atribuirse al autor humano detrás del resulto , cuándo dicha autoría intelectual corresponde realmente a la propia IA y cuando el resultado producido por la IA es una mera decodificación y codificación de una obra con derechos de autor, y por tanto, un mero plagio.

¿Puede realmente la AI plagiar obras con derechos de autor?... de ser así, ¿cómo podría evitarse?

Los gurus de la IA responden que, en efecto, la AI plagia y proponen técnicas para evitar este plagio:

En su blogpost, "Generative AI’s end-run around copyright won’t be resolved by the courts", Narayanan y Kaapor, autores del prolífico blog AI Oil Snake sugieren entrenar a los modelos de lenguage con pre-instruciones de modo que no acepten solicitudes que implique infringir material con copyright ni tampoco proporcionar material con derechos de autor en sus respuestas.

Gary Marcus (autor ya mencionado en otras secciones) también ofrece una interesante perspectiva en su blogpost "No, multimodal ChatGPT is not going to “trivially” solve Generative AI's copyright problems". Marcus admite que existe un problema de "plagiarismo visual" en la GenAI, demostrando que agentes generadores de imágenes tan populares como Midjouney o Dalle-e han sido entrenado con imágenes que tienen copyright y que las imagines generadas por dichos agentes plagian elementos de imagénes con derechos de autor. Curiosamente, Marcus contradice a Narayanan y Kaapor al considerar que no es tan sencillo como instruir a la GenAI con prompts que impidan el uso de imágenes con copyright.

En los próximos posts continuaré abordando en este tema

Captura de pantalla del usuario de X que desató la polémica en contra del cartel del Ministerio de Infancia y Juventud